Mikroserwisy w przemyśle – o czym właściwie mówimy?

Różnice między mikroserwisami a klasycznymi systemami SCADA/MES/ERP

Architektura mikroserwisów w przemyśle spotyka się z zupełnie inną rzeczywistością niż ta znana z typowych aplikacji webowych. Klasyczne systemy SCADA, MES czy ERP były przez lata budowane jako duże, monolityczne aplikacje – często jeden dostawca, jeden stack technologiczny, jedno centralne wdrożenie, rozbudowywane latami. W wielu fabrykach nadal działają ciągle te same instalacje, jedynie łata się je dodatkowymi modułami i kolejnymi integracjami.

Mikroserwisy odwracają ten schemat: zamiast jednego wielkiego programu powstaje zbiór niewielkich usług, z których każda wykonuje ściśle określone zadanie – np. rejestruje alarmy z linii, oblicza wskaźniki OEE, komunikuje się z konkretnym typem sterownika PLC albo udostępnia API do raportów dla menedżerów. Każdy taki mikroserwis można niezależnie rozwijać, skalować, wdrażać i… także niezależnie dobierać dla niego język programowania.

Tradycyjny SCADA to zwykle aplikacja wizualizacyjna plus warstwa komunikacji z PLC, często mocno związana z jednym systemem operacyjnym (zwykle Windows) i jedną platformą. Mikroserwisy w przemyśle dzielą te funkcje na osobne elementy: osobny serwis do zbierania danych, osobny do normalizacji, osobny do analizy czy do integracji z ERP. Dzięki temu łatwiej izolować awarie i aktualizować tylko wybrane fragmenty bez zatrzymywania całego systemu produkcyjnego.

Różnica kluczowa z perspektywy fabryki? Monolit SCADA/MES jest trudny do modyfikacji bez ryzyka dłuższego przestoju, a więc zmiany robi się rzadko i z dużym stresem. Architektura mikroserwisów pozwala wdrażać mniejsze zmiany częściej – pod warunkiem, że dobrze dobrane są języki programowania, narzędzia i standardy integracji. W przeciwnym razie zamiast elastyczności otrzymasz chaos technologiczny.

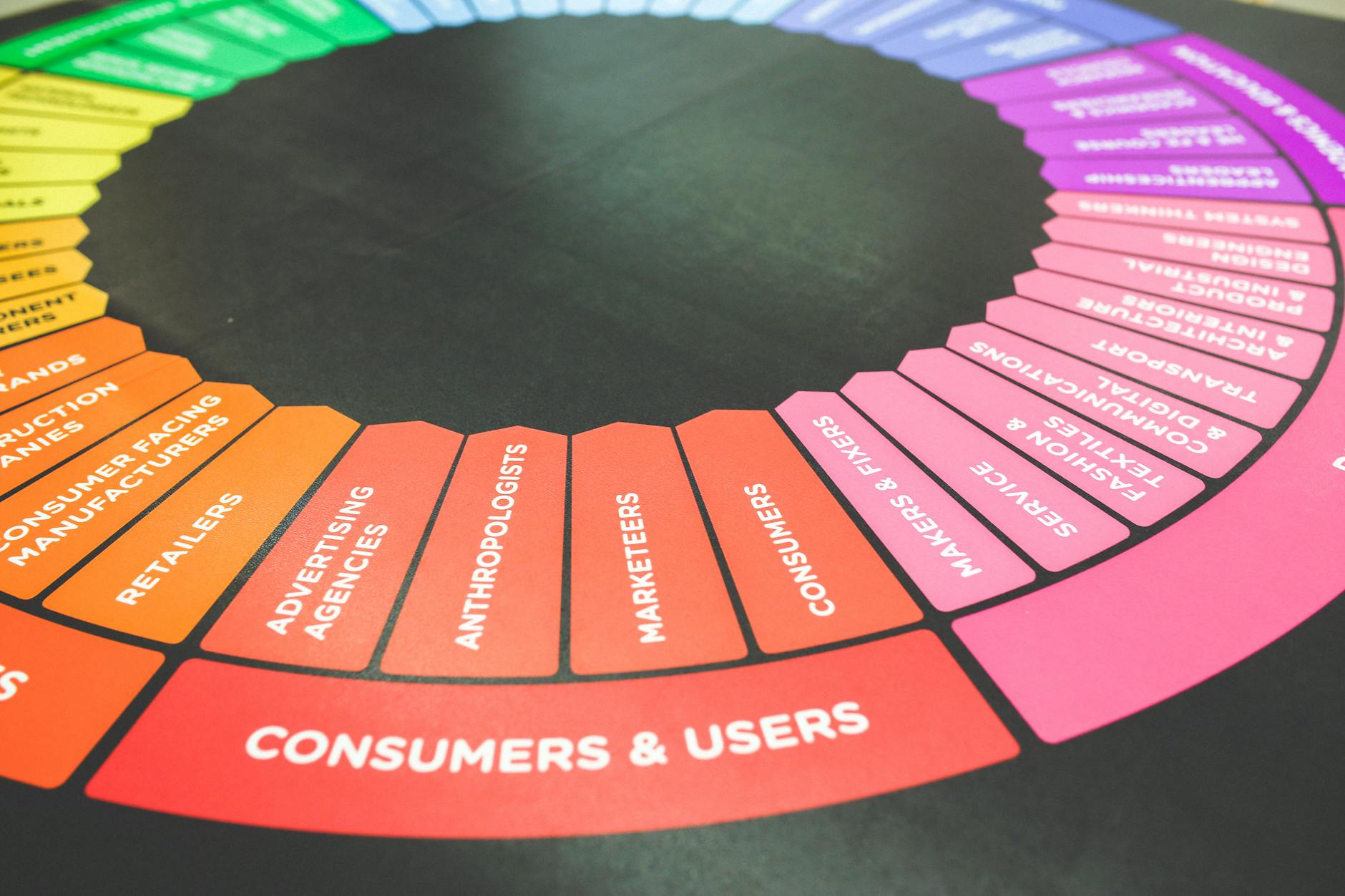

Typy systemów przemysłowych i ich potrzeby

Różne systemy przemysłowe mają inne wymagania, a to wprost przekłada się na decyzje technologiczne. Mikroserwisy w przemyśle zwykle pojawiają się w kilku powtarzających się obszarach:

- Linie produkcyjne i sterowanie – blisko maszyn, gdzie liczy się deterministyczność i niska latencja. Tu królują sterowniki PLC, czasem edge computing, integracja z robotami, systemami wizyjnymi, czujnikami. Mikroserwisy pełnią rolę „mostków” między światem OT a IT.

- Monitoring, alarmowanie, wizualizacje – agregacja statusów, alarmów, danych procesowych. Serwisy odpowiedzialne za zbieranie danych w czasie zbliżonym do rzeczywistego, przetwarzanie strumieniowe, powiadomienia.

- Traceability i jakość – śledzenie pochodzenia surowców, partii, parametrów procesu. Mikroserwisy zarządzają danymi identyfikacyjnymi, historią operacji, integracją z systemami jakości i laboratoriów.

- Utrzymanie ruchu – zbieranie danych o awariach, analiza predykcyjna, planowanie przeglądów, integracja z CMMS. Tu pojawiają się mikroserwisy analityczne i integracyjne z narzędziami biznesowymi.

- Raportowanie i analityka – warstwa bliżej biznesu: raporty produkcyjne, KPI, dashboardy menedżerskie, integracje z BI, hurtownie danych, chmura.

Każdy z tych obszarów ma inne priorytety: czas odpowiedzi, bezpieczeństwo, skalowalność, możliwości analityczne. W efekcie nie istnieje jeden „idealny język programowania dla mikroserwisów przemysłowych”. Trzeba dobrać technologię do rodzaju serwisu i jego miejsca między światem OT i IT.

Dlaczego producenci i integratorzy OT/IT przechodzą na mikroserwisy

Co stojące za tym powody widzisz u siebie? Najczęściej są to:

- Rosnąca złożoność systemów – liczba integracji, wymiana danych między fabrykami, wymagania klientów (np. śledzenie partii w czasie rzeczywistym) sprawiają, że monolity rosną w niekontrolowany sposób.

- Potrzeba szybszych zmian – presja na skrócenie time-to-market nowych funkcji: raportów, integracji, paneli dla klientów. Monolit blokuje szybkie dostarczanie.

- Integracja OT z IT – mikroserwisy są wygodnym „klejem” między przemysłowymi protokołami a biznesowymi API i systemami chmurowymi.

- Skalowalność i redundancja – niektóre funkcje można powielać horyzontalnie (np. serwisy zbierania danych), inne uruchamiać w klastrach dla wysokiej dostępności.

- Odporność na awarie – awaria jednej funkcji (np. raportowania) nie powinna zatrzymać całej produkcji.

Dla integratora systemów lub działu IT oznacza to przesunięcie akcentu: mniej centralnych „potworów” technologicznych, więcej mniejszych elementów. Zyskujesz elastyczność, ale płacisz złożonością architektury, większym wymaganiem wobec zespołu i… głębszym namysłem nad doborem języków programowania.

Mikroserwisy a realny sprzęt: PLC, sensory, roboty

W wielu wdrożeniach architektura mikroserwisów w przemyśle kończy się bardzo blisko fizycznego sprzętu. Mikroserwisy komunikują się z:

- sterownikami PLC przez OPC UA, Modbus/TCP, Profinet czy inne protokoły producentów,

- czujnikami i urządzeniami IoT po MQTT, REST, czasem po surowym TCP/UDP,

- robotami przemysłowymi i systemami wizyjnymi przez dedykowane SDK i sterowniki.

Szybko pojawia się więc pytanie: który język programowania ma najlepsze wsparcie dla konkretnych protokołów i bibliotek? Na przykład w świecie OPC UA dobrze ma się C#, C++ i Java (i przez JVM również Kotlin), za to w lekkim edge-computingu obserwuje się często Go i C. Dla MQTT biblioteki istnieją praktycznie w każdym większym języku, ale różnią się jakością, wsparciem TLS, stabilnością klienta w długotrwałych połączeniach itd.

Warto przy tym rozdzielić dwie role: mikroserwis bezpośrednio mówiący z PLC (często uruchamiany blisko linii, na gatewayu lub przemysłowym PC) oraz mikroserwis „po stronie IT”, konsumujący już oczyszczone i ujednolicone dane przez message broker, API lub szynę danych. Te dwie warstwy mają inne wymagania i mogą, a nawet powinny, używać innych technologii.

Gdzie jesteś: bliżej maszyn czy bliżej biznesu?

Twoje miejsce w tej układance mocno determinuje wybór języka. Pracujesz bliżej maszyn (OT), tworzysz integracje z PLC, systemami wizyjnymi, panelami HMI? A może jesteś bliżej biznesu (IT), odpowiedzialny za raportowanie, integracje z ERP, analitykę, aplikacje webowe?

Jeśli OT jest twoim światem, szczególnie ważne będą biblioteki do komunikacji z przemysłowymi protokołami, deterministyczność, stabilność procesu uruchomionego na edge’u, a także możliwości integracji z istniejącymi narzędziami SCADA. Jeśli zaś działasz w IT, częściej priorytetem będzie wygodne tworzenie API, szybkie wdrażanie, skalowanie w chmurze, łatwa rekrutacja programistów i gotowe biblioteki do integracji biznesowych.

Specyfika środowiska przemysłowego a wybór języka

Ograniczenia i wymagania: deterministyczność, latencja, stabilność

Środowisko przemysłowe ma swoje nieprzejednane reguły. Produkcja pracuje często 24/7, a przerwa choćby na godzinę oznacza realne straty. Mikroserwisy w przemyśle muszą więc radzić sobie w warunkach, gdzie:

- deterministyczność ma znaczenie – pewne operacje muszą wykonać się w przewidywalnym czasie, nawet jeśli nie w ścisłym „hard real-time” jak w PLC, to jednak bez losowych opóźnień po kilkaset milisekund,

- latencja bywa kluczowa – np. przy rejestrowaniu zdarzeń procesowych w czasie rzeczywistym, synchronizacji z linią pakowania, szybkim alarmowaniu,

- stabilność 24/7 to nie życzenie, ale wymóg kontraktowy – mikroserwisy muszą wytrzymywać tygodnie lub miesiące pracy bez restartu, aktualizacje trzeba planować pod okna serwisowe,

- sprzęt i sieć bywają kapryśne – linie produkcyjne mają swoje VLAN-y, stare switche, czasem dziwne ograniczenia bezpieczeństwa, a przemysłowe PC potrafią działać latami bez wymiany.

To wszystko wpływa na dobór technologii. Języki interpretowane z ciężkim środowiskiem uruchomieniowym (np. Python z rozbudowaną masą bibliotek) mogą być świetne do analityki, ale przy ograniczonym sprzęcie edge albo konieczności minimalizacji overheadu – będą trudniejsze w utrzymaniu. Z drugiej strony języki kompilowane do natywnego kodu (Go, C, C++) lub dobrze zoptymalizowane runtime’y (JVM, .NET) lepiej znoszą długotrwałe obciążenie, jeśli zadbamy o monitoring i profilowanie.

Brzeg sieci vs chmura: dwa światy mikroserwisów

Mikroserwisy „bliżej hali” (edge) i te działające w chmurze pełnią różne role i podlegają różnym ograniczeniom. Warto je omówić osobno.

Mikroserwisy na brzegu sieci (edge):

- pracują na przemysłowych PC, gatewayach IoT, routerach przemysłowych, czasem na wbudowanych urządzeniach,

- mają ograniczone zasoby sprzętowe: RAM, CPU, przestrzeń dyskowa, brak GPU,

- często działają w sieciach odciętych od internetu lub o ograniczonej łączności,

- komunikują się bezpośrednio z PLC, czujnikami, robotami, systemami wizualizacji.

Dla takich mikroserwisów liczy się:

- lekkość runtime’u i kontenera,

- współpraca z konkretnym systemem operacyjnym (często Windows lub Linux na starszym kernelu),

- łatwość uruchomienia jako usługa systemowa, integracja z logowaniem i monitoringiem na miejscu.

W tym obszarze dominują języki takie jak C/C++, C#/.NET (szczególnie w środowiskach Windows i SCADA), coraz częściej również Go i czasem Rust. Java też jest obecna, ale narzut JVM bywa problemem w bardzo ograniczonych środowiskach.

Mikroserwisy w chmurze lub centrum danych:

- pracują w klastrach Kubernetes, Docker Swarm lub innych orkiestratorach,

- komunikują się głównie przez HTTP/REST, gRPC, kolejki wiadomości,

- obsługują integracje z ERP, MES, CRM, systemami BI, hurtowniami danych,

- przetwarzają duże wolumeny danych historycznych, strumienie z linii, raporty.

Tu ważna jest:

- elastyczność, bogaty ekosystem bibliotek,

- współpraca z chmurami publicznymi (Azure, AWS, GCP),

- dobre wsparcie narzędzi DevOps i CI/CD.

W tym świecie bardzo mocne są Java/Kotlin, C#/.NET, Go, ale też Node.js czy Python do części zadań (np. analityka, machine learning, integracje pomocnicze). Dobór języka dla mikroserwisu warto więc zacząć od odpowiedzi: czy ten serwis żyje bardziej w świecie OT, czy już w świecie IT?

Standardy i protokoły przemysłowe a dostępne biblioteki

Kluczowa praktyczna kwestia: jakie protokoły przemysłowe muszą obsłużyć twoje mikroserwisy i jak wygląda wsparcie dla nich w poszczególnych językach programowania? Przykłady:

- OPC UA – bardzo popularny standard w przemyśle. Dobre, dojrzałe implementacje klienta i serwera istnieją w C, C++, C#, Javie. Są też biblioteki w Pythonie i Go, ale często mniej kompletne lub droższe komercyjnie.

- Modbus (TCP/RTU) – prosty, szeroko wspierany protokół; biblioteki znajdziesz praktycznie w każdym języku (C, C#, Java, Go, Python, Node.js), różnią się jednak jakością i wsparciem.

- MQTT – standard de facto dla IoT. Klientów MQTT jest bardzo wiele (Java, C#, Go, Python, JavaScript, Rust) i tu wybór języka nie jest aż tak ograniczający.

- Profinet, EtherNet/IP, protokoły producentów robotów – często wymagają użycia specyficznych SDK, czasem dostępnych tylko dla C/C++ lub C#. To mocno zawęża wybór języka dla mikroserwisów bezpośrednio gadających z urządzeniami.

Jeśli twój projekt wymaga głębokiej integracji z OPC UA po stronie serwera (np. wystawiasz dane z linii jako serwer OPC UA), wybór języka z dobrym, dojrzałym stosem OPC UA (np. C#, Java) znacząco zmniejszy ryzyko. Z kolei jeśli twoje mikroserwisy otrzymują dane już pośrednio, przez MQTT lub HTTP od bramy edge, możesz znacznie swobodniej dobierać język.

Cykl życia systemów przemysłowych kontra cykl życia technologii

Systemy przemysłowe żyją długo. Dziesięć lat to norma, dwadzieścia lat nie jest niczym zaskakującym. Z kolei języki programowania, frameworki webowe, biblioteki zmieniają się dynamicznie, niektóre gasną po kilku latach. Jak to zderzyć z rzeczywistością OT?

Jak długo ma żyć twój kod?

Cykl życia linii produkcyjnej to zupełnie inna skala niż cykl życia frameworka webowego. Jeżeli planujesz system, który ma przetrwać wiele lat, dobrze jest odpowiedzieć sobie szczerze: czy będziesz go aktywnie rozwijać, czy raczej „zamrozisz” po wdrożeniu i tylko łatki bezpieczeństwa będą wchodzić co jakiś czas?

Jeśli stawiasz na długi, spokojny żywot, bardziej opłaca się wybór stabilnych platform: Java, .NET, C/C++. Nowe funkcje pojawiają się tam regularnie, ale rdzeń języka i podstawowe biblioteki zmieniają się wolniej, z dużym naciskiem na kompatybilność wsteczną. Ryzyko, że po pięciu latach nikt nie będzie znał danego frameworka niszowego, jest mniejsze.

Przy projektach, które same w sobie są eksperymentem (np. pilotażowe wykorzystanie AI do inspekcji jakości), można świadomie sięgnąć po bardziej „modne” technologie, np. Node.js, Python z konkretnym frameworkiem webowym. Pytanie tylko: czy ten pilot nie stanie się po cichu produktem krytycznym? Tu wiele firm się już sparzyło.

Proste ćwiczenie: zrób listę technologii, które chcesz użyć, a potem dopisz, od ilu lat są na rynku i jak wygląda ich wsparcie przez duże firmy. Java, .NET, C, C++, JavaScript/Node.js mają silnych „sponsorów” i to bywa lepszą polisą ubezpieczeniową niż błyskotliwy framework, o którym głośno jest dopiero od dwóch lat.

Kryteria doboru języka w mikroserwisach – praktyczna matryca decyzji

Jak podejść do wyboru: najpierw problemy, potem technologia

Zanim wpiszesz w Google „który język do mikroserwisów”, zatrzymaj się na chwilę i odpowiedz na kilka pytań diagnostycznych:

- Jak blisko jesteś maszyn (OT), a jak blisko systemów biznesowych (IT)?

- Czy Twoje mikroserwisy będą działały głównie na edge, czy w chmurze/centrum danych?

- Jakie protokoły i urządzenia musisz obsłużyć w pierwszej kolejności?

- Jak długo system ma działać bez poważnej przebudowy?

- Jakich ludzi masz dzisiaj w zespole i kogo możesz zrekrutować na rynku?

Odpowiedzi wskazują mocne preferencje technologiczne. Jeśli np. większość integracji robisz na Windows Server, a integrujesz się z istniejącymi systemami SCADA w .NET – wybór C#/.NET pod wiele mikroserwisów będzie naturalny. Jeśli natomiast budujesz „chmurowy mózg produkcji” na Kubernetesie, a zespół zna świetnie JVM, Java/Kotlin zwykle wygra.

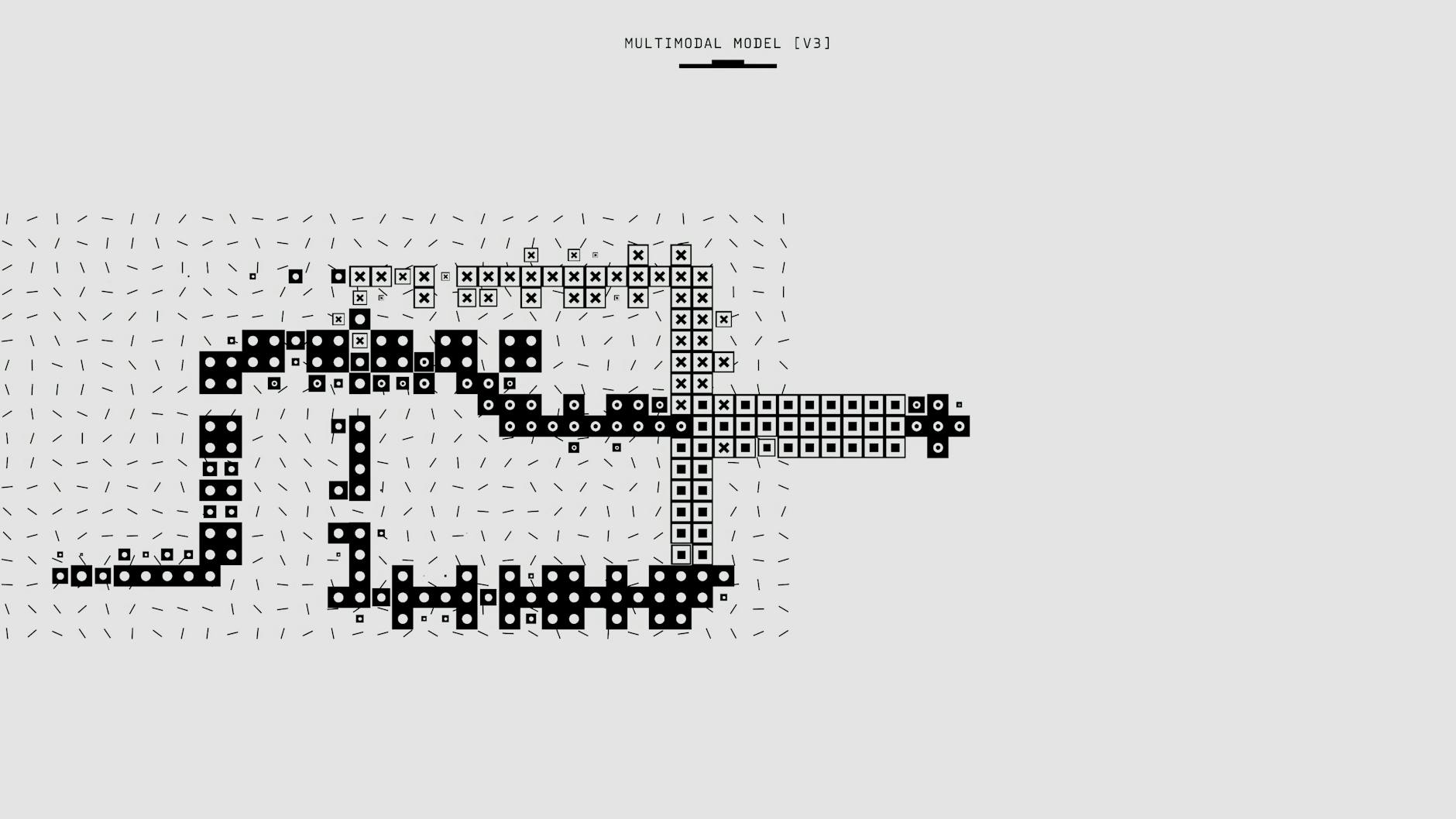

Oś pierwsza: OT vs IT – gdzie pracuje mikroserwis?

Możesz spojrzeć na swoje mikroserwisy jak na punkty na osi: z jednej strony OT (blisko maszyn), z drugiej IT (blisko biznesu). Gdzie plasuje się każdy z nich?

- Bliżej OT – preferowane języki: C/C++, C#, czasem Go, okazjonalnie Rust.

- Strefa pośrednia (bramy danych, agregacja) – C#, Java/Kotlin, Go.

- Bliżej IT – Java/Kotlin, C#, Node.js, Python, Go.

Weź konkretny serwis, np. adapter do OPC UA po stronie linii. Czy naprawdę chcesz pisać go w Pythonie, skoro biblioteki w C# lub C++ są stabilniejsze i lepiej wspierane? Z drugiej strony, czy warstwa raportowa, generująca PDF-y dla kierownika produkcji, musi być w C++, skoro łatwiej ją utrzymać w C# lub Kotlinie?

Oś druga: wydajność i deterministyczność vs tempo developmentu

Druga oś matrycy to kompromis między prędkością wykonania a prędkością pisania kodu. Jakie masz priorytety?

- Wysoka wydajność, niskie opóźnienia, przewidywalność – królują C/C++, Go, dobrze napisany C# lub Java (z odpowiednią konfiguracją GC).

- Szybki development, bogaty ekosystem – tu wygrywają Java/Kotlin (Spring, Micronaut, Quarkus), C#/.NET, Node.js, Python.

Jeśli głównym wąskim gardłem jest sieć, a nie CPU, zysk z ultra-optymalizacji kodu w C++ może być iluzoryczny. Wtedy lepiej sięgnąć po język, w którym zespół szybciej dowiezie funkcjonalność i testy. Natomiast dla mikroserwisów, które wykonują intensywne obliczenia (np. agregacje tysiąca sygnałów w krótkim oknie czasowym), inwestycja w bardziej wydajny język może się spłacić.

Oś trzecia: kompetencje zespołu i rynek pracy

Nawet najlepsza technologia nie pomoże, jeśli nie ma komu jej utrzymywać. Zadaj sobie pytanie: w jakich językach Twój zespół czuje się dziś naprawdę pewnie?

Jeśli dominują .NET-owcy, zmuszanie ich do pisania w Go tylko dlatego, że „jest lekkie” może skończyć się wolniejszym developmentem i gorszym kodem. Z kolei jeśli masz mocny zespół javowy, naturalne będzie stawianie większości mikroserwisów na JVM, a inne języki zostawić jako uzupełnienie do edge’u lub specyficznych komponentów.

Spójrz też na rynek lokalny: w niektórych regionach łatwiej znaleźć .NET-owców, w innych specjalistów od Javy, a w jeszcze innych – programistów C/C++ obecnych w automatyce od lat. Języki egzotyczne w Twoim kontekście mogą wyglądać atrakcyjnie technicznie, ale zwiększają ryzyko, że za dwa lata zostaniesz z kodem, którego nikt nie chce dotykać.

Oś czwarta: ekosystem przemysłowy, licencje i wsparcie vendorów

Kolejna, często pomijana perspektywa: jakich technologii używają dostawcy sprzętu, SCADA, MES, którzy już są na Twojej fabryce? Zdarza się, że:

- vendor SCADA daje oficjalne SDK tylko dla C# lub C++,

- dostawca robotów przemysłowych wspiera wyłącznie integrację przez biblioteki .NET,

- platforma IIoT, którą kupił dział centralny, ma najlepiej udokumentowane SDK w Javie lub TypeScript.

W takim środowisku warto iść z prądem, a nie pod niego. Jeżeli większość dostawców automatyki w Twoim zakładzie żyje w świecie Windows + .NET, budowanie całego ekosystemu na Node.js czy Rust może przynieść niepotrzebne tarcia integracyjne. Odwrotna sytuacja: gdy centrala korporacji standaryzuje się na JVM i Kubernetesie, a Ty wybierzesz niszową technologię dla krytycznych serwisów, później będzie trudno wpiąć się w ich narzędzia DevOps i obserwowalność.

Matryca decyzji – jedno mikroserwis, jeden wybór

Dobrym podejściem jest stworzenie prostej matrycy dla każdego planowanego mikroserwisu. Dla przykładu:

- Serwis A: brama OPC UA → MQTT na edge

– lokalizacja: OT/edge

– wymagania: stabilność 24/7, obsługa specyficznego SDK producenta PLC (C#), niski narzut zasobów

– zespół: mocny w .NET, znajomość OPC UA

– kandydaci: C#, C++

– wybór: C#/.NET (łatwa integracja, dobre SDK, szybki development) - Serwis B: agregacja danych i API do raportowania w chmurze

– lokalizacja: IT/chmura

– wymagania: skalowalność, szybkie tworzenie API, integracje z ERP, raportowanie

– zespół: Java i Kotlin, doświadczenie z Spring Boot

– kandydaci: Java, Kotlin, C#

– wybór: Kotlin na JVM (korzystanie z istniejącej infrastruktury, wydajność i ergonomia języka)

Kiedy zrobisz taką analizę dla kilku mikroserwisów, pojawi się naturalny „rdzeń” technologiczny (np. JVM lub .NET) oraz kilka języków pomocniczych dla specyficznych zadań (C/C++ na edge, Python do AI itp.). To często lepsza strategia niż próba zmieszczenia wszystkiego w jednym języku lub przeciwnie – wprowadzenie pięciu języków bez wyraźnej potrzeby.

Java i Kotlin w przemyśle – ciężkie działa czy złoty środek?

JVM na hali i w chmurze – gdzie ma sens?

Java i Kotlin żyją na tej samej maszynie wirtualnej (JVM), więc większość argumentów technicznych dotyczy ich obu. Pytanie brzmi: gdzie w przemyśle JVM ma największy sens, a gdzie może być przesadą?

W warstwie chmurowej i serwerowej Java/Kotlin są wręcz naturalnym kandydatem. Dojrzałe frameworki (Spring Boot, Micronaut, Quarkus), narzędzia do testów, monitoringu, integracji, ogromna baza programistów – to wszystko sprawia, że mikroserwisy oparte o JVM łatwo wpasować w istniejące procesy DevOps. Jeżeli Twoje mikroserwisy łączą świat produkcji z ERP, systemami BI, hurtowniami danych – Java i Kotlin mają tutaj bardzo mocną pozycję.

Na edge’u sytuacja jest bardziej zniuansowana. JVM ma większy narzut pamięci niż natywny kod w C/C++ czy Go. Na nowoczesnych przemysłowych PC to zwykle nie jest problem, ale na małych gatewayach z 1–2 GB RAM może już być ciasno. Jeżeli planujesz uruchamiać kilka JVM-ów na jednym urządzeniu, warto to policzyć i przetestować na żywym sprzęcie.

Zalety Javy i Kotlina w środowisku przemysłowym

Gdy spojrzysz na wymagania typowego systemu produkcyjnego od strony IT, wychodzi ciekawa lista rzeczy, w których JVM się sprawdza:

- Stabilny runtime – Java jest na produkcji w firmach przemysłowych od kilkunastu, a nawet kilkudziesięciu lat. Wiele problemów i wzorców jest już dobrze poznanych.

- Bogaty ekosystem integracyjny – biblioteki do komunikacji z bazami danych, brokerami (Kafka, RabbitMQ, MQTT), systemami chmurowymi, LDAP-em, OAuthem – praktycznie wszystko istnieje i jest utrzymywane.

- Dojrzałe frameworki webowe i integracyjne – budowanie REST-ów, gRPC, GraphQL, obsługa wsparcia dla OpenAPI, łatwa dokumentacja – to wszystko jest niemal „z pudełka”.

- Wieloplatformowość – ten sam kod uruchomisz na Windowsie (blisko SCADA), Linuxie w data center i w chmurze publicznej.

- Długowieczność – Java nie jest modą, tylko standardem w wielu korporacjach przemysłowych. Kotlin korzysta z tego ekosystemu, dodając nowoczesną składnię i lepszą ergonomię.

Jeśli Twoim celem jest budowa długowiecznego „systemu nerwowego” fabryki – integracje, API, przetwarzanie strumieni danych z linii – Java/Kotlin często stają się rozsądnym kompromisem między wydajnością, wygodą a długoterminowym wsparciem.

Potencjalne pułapki: JVM nie jest magiczny

Oczywiście nic nie jest za darmo. JVM ma swoje słabości, które w przemyśle trzeba świadomie adresować:

- Zużycie pamięci – domyślne ustawienia JVM potrafią zająć sporo RAM-u. Dla mikroserwisów na edge’u trzeba dobrać parametry GC i limity heapu, inaczej na małych urządzeniach szybko pojawi się presja pamięci.

- Garbage Collector – w większości przypadków nowoczesne GC są przewidywalne, ale w środowisku wymagającym bardzo niskiej latencji trzeba je świadomie konfigurować, a czasem ograniczać alokacje.

- Czas rozruchu – klasyczny Spring Boot startuje sekundami, nie milisekundami. W wielu systemach przemysłowych to akceptowalne, ale przy częstych restartach lub na edge’u czas uruchomienia może mieć znaczenie. Tu pomagają lżejsze frameworki (Micronaut, Quarkus) lub kompilacja natywna (GraalVM) – kosztem złożoności pipeline’u.

Zanim postawisz kilkadziesiąt mikroserwisów w JVM na edge’u, zrób testy: czy startują akceptowalnie szybko, jak zachowują się pod długotrwałym obciążeniem, jaką mają charakterystykę GC. Może się okazać, że część serwisów spokojnie pracuje na JVM, a kilka najbardziej wrażliwych lepiej przepisać na Go lub C#.

Kiedy Java, kiedy Kotlin?

W praktyce przemysłowej wybór między Javą a Kotlinem zwykle nie jest kwestią technicznych barier, tylko ergonomii i dojrzałości zespołu. Java ma dłuższą historię, więcej materiałów szkoleniowych, wielu inżynierów już ją zna. Kotlin z kolei:

- skraca kod (mniej „ceremonii”),

- ma lepszy system obsługi nulli (mniej błędów w stylu NullPointerException),

- dobrze integruje się ze Springiem i innymi frameworkami JVM.

Jeżeli zespół już zna dobrze Javę, sensowna strategia bywa taka: nowe mikroserwisy, zwłaszcza w mniej krytycznych miejscach, pisać w Kotlinie, resztę rozwijać nadal w Javie. Obie technologie mogą współistnieć w jednym monorepo, korzystać z tych samych bibliotek i pipeline’ów CI/CD.

Przykład z praktyki: system MES i strumienie danych

W jednej z fabryk produkcji dyskretnej zespół IT miał stanąć przed zadaniem: zbieranie danych z kilkunastu linii, agregacja, zapisy do bazy time-series oraz wystawienie API do systemu MES i raportowania. Zespół znał głównie Javę, w firmie był już klaster Kubernetes, a centrala wymagała integracji z Azure.

Po analizie powstała architektura, w której:

- mikroserwisy zbierające dane z brokerów MQTT i zapisujące je do Kafki powstały w Javie (Spring Boot),

- serwis do transformacji i walidacji danych – w Kotlinie, korzystając z tych samych bibliotek,

Kontynuacja przykładu: miks Javy i Kotlina w tym samym ekosystemie

Całość działała na jednym klastrze Kubernetes, z ujednoliconym loggingiem, monitoringiem i mechanizmami deployu. Programiści mogli przeskakiwać między serwisami w Javie i Kotlinie bez zmiany narzędzi – różniła się głównie składnia, nie fundamenty.

Co to dało zespołowi?

- łatwiejszą rekrutację (szukano po prostu programistów JVM),

- stopniową adopcję Kotlina bez rewolucji w istniejącym kodzie,

- możliwość eksperymentów – pojedynczy, mniej krytyczny mikroserwis mógł stać się poligonem dla nowych technik (np. coroutines w Kotlinie).

Jeżeli jesteś w podobnym miejscu – masz silny ekosystem JVM, ale kuszą Cię nowocześniejsze narzędzia – możesz zadać sobie pytanie: który mikroserwis jest wystarczająco prosty, aby spróbować w nim Kotlina bez ryzyka dla całego systemu? Taka mała „piaskownica” bywa lepsza niż globalne ogłoszenie migracji technologicznej.

C# i .NET – naturalny wybór dla świata Windows i SCADA?

.NET na styku IT/OT – gdzie błyszczy najbardziej?

Jeżeli Twoja fabryka stoi na Windowsie, a SCADA, HMI i narzędzia inżynierskie dostawców automatyki są pisane pod .NET, to C# zwykle wchodzi do gry bez zaproszenia. Zwłaszcza tam, gdzie trzeba „dotknąć” sprzętu: biblioteki producentów PLC, sterowników, kart komunikacyjnych często są dostępne jedynie w formie DLL-ek dla .NET.

Gdzie C# sprawdza się szczególnie dobrze w architekturze mikroserwisów przemysłowych?

- Edge na Windowsie – mikroserwisy uruchamiane jako Windows Services lub w kontenerach na Windows Server/Windows IoT, integrujące się z lokalną SCADA.

- Integracje z oprogramowaniem dostawców – dodatki do systemów raportowych, pluginy do narzędzi inżynierskich, serwisy wykorzystujące oficjalne SDK .NET.

- Świat biurowy + przemysł – gdy trzeba połączyć dane z produkcji z pakietem Office, SharePointem, usługami AD/Entra ID czy innymi produktami Microsoftu.

Jednocześnie .NET od lat wychodzi poza Windows. .NET 6/7/8 działa bardzo dobrze na Linuksie, więc możesz mieć sytuację odwrotną: core mikroserwisów w chmurze działa na Linux + .NET, a tylko niektóre komponenty muszą zostać przy Windowsie ze względu na sterowniki lub legacy SCADA.

Zalety C#/.NET z perspektywy zakładu produkcyjnego

Jeżeli testujesz kilka platform równolegle, spróbuj przejść przez banalne, ale praktyczne pytania: kto to będzie utrzymywał? jakie narzędzia już mamy? co jest największym problemem dziś – integracja, wydajność, czy brak ludzi? W przypadku .NET lista plusów często układa się tak:

- Silne zakorzenienie w automatyce – wielu dostawców SCADA/MES publikuję SDK, przykłady i skrypty w C#. Daje to gotowe wzorce integracji.

- Dobre wsparcie narzędziowe – Visual Studio, Rider czy VS Code z rozszerzeniami zapewniają wygodne debugowanie serwisów, także tych działających na zdalnych maszynach w zakładzie.

- Nowoczesny runtime – CoreCLR jest wydajny, ma przewidywalny GC, dobrze współpracuje z kontenerami. Mikroserwisy .NET potrafią być zaskakująco „lekkie”, jeśli trzyma się w ryzach zależności.

- Szybkie budowanie API – ASP.NET Core, minimal APIs, wbudowane wsparcie dla OpenAPI/Swagger, integracja z gRPC – wystarczają w większości scenariuszy integracyjnych.

- Ścisła integracja z Azure – jeśli korporacja stawia na chmurę Microsoftu, serwisy .NET zazwyczaj mają najwięcej przykładów, gotowych SDK i szablonów.

Dla wielu organizacji kluczowy jest jeszcze jeden aspekt: stosunkowo łatwo znaleźć inżynierów C# z doświadczeniem w świecie biznesowym, którzy są w stanie „wejść” w przemysł, niż odwrotnie. Mikroserwisy integracyjne często przypominają zwykłe systemy biznesowe – różnica polega na tym, że dane wpadają z linii, a nie z aplikacji CRM.

Pułapki .NET w środowisku przemysłowym

C#/.NET nie jest srebrną kulą. Przed decyzją dobrze zadać sobie kilka pytań naprowadzających: czy będziemy mocno zależeć od Windowsa? czy nasz dział bezpieczeństwa akceptuje kontenery Windows? czy mamy już w firmie sensowne praktyki DevOps dla .NET?

Do typowych wyzwań należą:

- Lock-in na platformę – choć .NET jest wieloplatformowy, część bibliotek przemysłowych (szczególnie starszych) działa tylko na Windowsie. To może ograniczyć wybór platformy kontenerowej czy systemów operacyjnych na edge.

- Mieszane środowiska – gdy IT standardowo używa Linuksa i Dockera, a OT trzyma się Windowsa i usług systemowych, spójne zarządzanie mikroserwisami .NET bywa trudniejsze organizacyjnie niż technicznie.

- Zarządzanie wersjami runtime’u – jednoczesne utrzymanie kilku wersji .NET (stare aplikacje na .NET Framework, nowe na .NET 8) wymaga dyscypliny w zarządzaniu środowiskami.

Jeżeli Twój zakład ma już „zoo” technologiczne, dobrym ćwiczeniem jest spisanie, które serwisy muszą być naprawdę blisko sprzętu i zamkniętych SDK, a które mogą spokojnie żyć na Linux + .NET w chmurze. Często wychodzi, że w samej warstwie integracyjnej wystarczy kilka serwisów ściśle zależnych od Windowsa, reszta może być przenośna.

ASP.NET Core w mikroserwisach – lekkie podejście czy monolit w przebraniu?

Dużo zależy od sposobu użycia frameworka. ASP.NET Core pozwala zarówno na bardzo lekkie serwisy z minimalnymi zależnościami, jak i na rozbudowane aplikacje, które z czasem stają się kolejnym „półmonolitem”. Jak rozpoznać, w którą stronę idziesz?

Spójrz na kilka prostych sygnałów:

- czy w jednym serwisie obsługujesz kilka, zupełnie niezależnych obszarów domenowych (np. rejestracja alarmów, planowanie produkcji i autoryzacja użytkowników)?

- czy deploy jednego serwisu wymusza testy w wielu różnych działach (utrzymanie ruchu, logistyka, jakość)?

- czy liczba zależności NuGet rośnie szybciej niż liczba faktycznie używanych funkcjonalności?

Jeśli odpowiadasz „tak” częściej niż byś chciał, sygnał jest prosty: czas podzielić serwis. C#/.NET świetnie się do tego nadaje – możesz wydzielić osobne projekty, a nawet współdzielić część bibliotek domenowych. Największą barierą bywa psychologia zespołu, nie technologia.

Przykład z praktyki: brama SCADA i mikroserwisy raportowe

W zakładzie procesowym, gdzie główny system SCADA działał na Windows Server, zespół stanął przed zadaniem wystawienia danych do systemu BI. Początkowo powstała jedna duża aplikacja .NET, która:

- łączyła się z bazą SCADA,

- mapowała zmienne procesowe na tagi raportowe,

- wystawiała API dla chmury,

- generowała raporty do Excela na żądanie działu jakości.

Brzmiało jak „szybkie rozwiązanie”, ale każdy deploy tej aplikacji wymagał koordynacji trzech działów i okien serwisowych. Po roku pojawiła się naturalna granica: część funkcjonalności spokojnie mogła działać niezależnie.

Podział wyglądał finalnie tak:

- lekki serwis C# łączący się z SCADA i wystawiający dane w ujednoliconym formacie,

- osobny mikroserwis mapujący i walidujący tagi dla raportowania,

- mikroserwis generujący raporty i wysyłający je mailem – przeniesiony do chmury, nadal w .NET, ale już na Linuxie.

Dzięki takiemu rozcięciu część krytyczna (integracja ze SCADA) pozostała blisko systemu na Windowsie, a warstwa „biznesowa” mogła korzystać z dobrodziejstw środowiska chmurowego. Pojawiło się też miejsce na eksperymenty: raporty historyczne zaczęto generować partiami w Azure Functions, również w C#, bez dotykania edge’owych komponentów.

.NET na Linuxie i w kontenerach – realna opcja na produkcji

W wielu głowach .NET nadal bywa kojarzony z Windows Server i IIS. Tymczasem w nowoczesnych wdrożeniach przemysłowych coraz częściej spotyka się kombinację: Linux + .NET + Kubernetes. Jak to wykorzystać pod świat mikroserwisów w przemyśle?

Kilka praktycznych scenariuszy:

- Warstwa integracyjna w chmurze – mikroserwisy .NET na Linuxie obsługują komunikację z brokerami MQTT, Kafką czy systemami ERP, trzymając logikę bliżej biznesu niż sprzętu.

- Przeniesienie części obciążeń z hali do data center – cięższe obliczeniowo zadania (np. agregacje historyczne, analizy OEE) można oderwać od edge’a, zostawić tam jedynie proste kolektory.

- Ujednolicenie pipeline’u CI/CD – ten sam zestaw narzędzi do budowania i deployu można stosować dla serwisów .NET i np. Javy, jeśli obie działają w kontenerach Linuksowych.

Jeśli rozważasz takie podejście, przyda się diagnostyczne pytanie: które z naszych serwisów naprawdę muszą widzieć sterowniki i magistrale komunikacyjne, a które tylko przyjmują dane po HTTP/MQTT/Kafce? Te drugie są naturalnymi kandydatami do migracji na .NET + Linux, z dala od ograniczeń typowych dla środowiska OT.

Kiedy C#, kiedy jednak coś innego?

W wielu zakładach wybór C# wynika z inercji: „bo SCADA jest na Windowsie, więc wszystko róbmy w .NET”. Warto ten nawyk przetestować kilkoma prostymi pytaniami:

- czy dany mikroserwis musi korzystać z bibliotek dostępnych tylko w .NET?

- czy będzie utrzymywany głównie przez zespół, który zna C#, czy raczej przez ludzi od Javy/Pythona?

- czy serwis będzie działał w środowisku, w którym dominują narzędzia Microsoftu, czy raczej w neutralnej chmurze/Kubernetesie?

Jeśli trzy razy z rzędu pojawia się „nie”, być może C# nie jest najlepszym kandydatem i sensowniej sięgnąć po technologię bliższą reszcie ekosystemu (np. Javę w świecie JVM albo Pythona dla serwisów analitycznych). Mikroserwisy dają ten komfort, że wybór można wiązać z konkretnym kontekstem, a nie z całą fabryką naraz.

Łączenie światów: JVM + .NET w jednym krajobrazie

Coraz częściej spotyka się zakłady, gdzie jednocześnie istnieją mocne kompetencje w Javie i C#. Zamiast forsować „jedyną słuszną” technologię, rozsądniej bywa przyjąć prostą zasadę: JVM dla integracji z systemami biznesowymi, .NET dla integracji blisko SCADA/Windows. Czy taki podział zawsze zadziała? Nie, ale jest dobrym punktem startu.

Żeby takie środowisko nie zamieniło się w chaos, przydają się wspólne reguły:

- ujednolicone standardy API (np. wszędzie REST + OpenAPI lub gRPC dla określonych przypadków),

- spójne praktyki logowania, metryk i trace’ów (narzędzia typu OpenTelemetry działają zarówno w JVM, jak i .NET),

- wspólny katalog „serwisów referencyjnych” – kilka przykładowych mikroserwisów w Javie i C#, pokazujących architekturę, struktury projektów, wzorce obsługi błędów.

Jeżeli pracujesz w organizacji, w której dwa obozy technologiczne patrzą na siebie nieufnie, dobrym ruchem bywa zbudowanie małego, ale krytycznego przepływu end-to-end, w którym oba światy współpracują: np. brama OPC UA w C#, serwis agregacji w Kotlinie, API raportowe znów w .NET. Taki „szyty na miarę” przepływ bywa konkretniejszym argumentem niż długie dyskusje o wyższości jednej platformy nad drugą.